Tomber en amour avec une intelligence artificielle

L’idée de tomber en amour avec une intelligence artificielle (IA) semble tout droit sortie d’un film de science-fiction. C’est pourtant une réalité, avec l’arrivée de robots conversationnels conçus spécifiquement pour incarner un partenaire amoureux. Mais prudence, car si ces robots peuvent être amusants ou bienveillants, les entreprises derrière amassent des données qui peuvent être embarrassantes, sans compter les écueils psychologiques possibles.

En 2013, le film Her, de Spike Jonze, mettait à l’affiche Joaquin Phoenix dans le rôle d’un homme solitaire qui tombait en amour avec l’intelligence artificielle de son téléphone intelligent (Scarlett Johansson). Une décennie plus tard, le sujet est plus brûlant d’actualité que jamais avec la popularité croissante de logiciels comme Replika, qui vise à offrir de véritables partenaires de vie virtuels à ses utilisateurs.

Ceci n’est pas ChatGPT

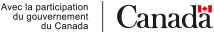

L’arrivée de l’IA générative permet la création de robots conversationnels dotés d’une personnalité spécifique, qui se souviennent en plus de toutes leurs interactions passées. On est donc loin de Siri ou même de ChatGPT, pour qui chaque nouvelle conversation représente un nouveau départ.

Alors que les IA comme ChatGPT permettent de discuter de tout et de rien, ces IA romantiques ont des personnalités bien à elles, qui peuvent dans certains cas être définies lors de leur création, ou évoluer au fil des conversations. Quelqu’un qui discute avec un pompier virtuel ne pourra pas lui demander de générer des images, comme c’est possible de le faire avec ChatGPT, par exemple.

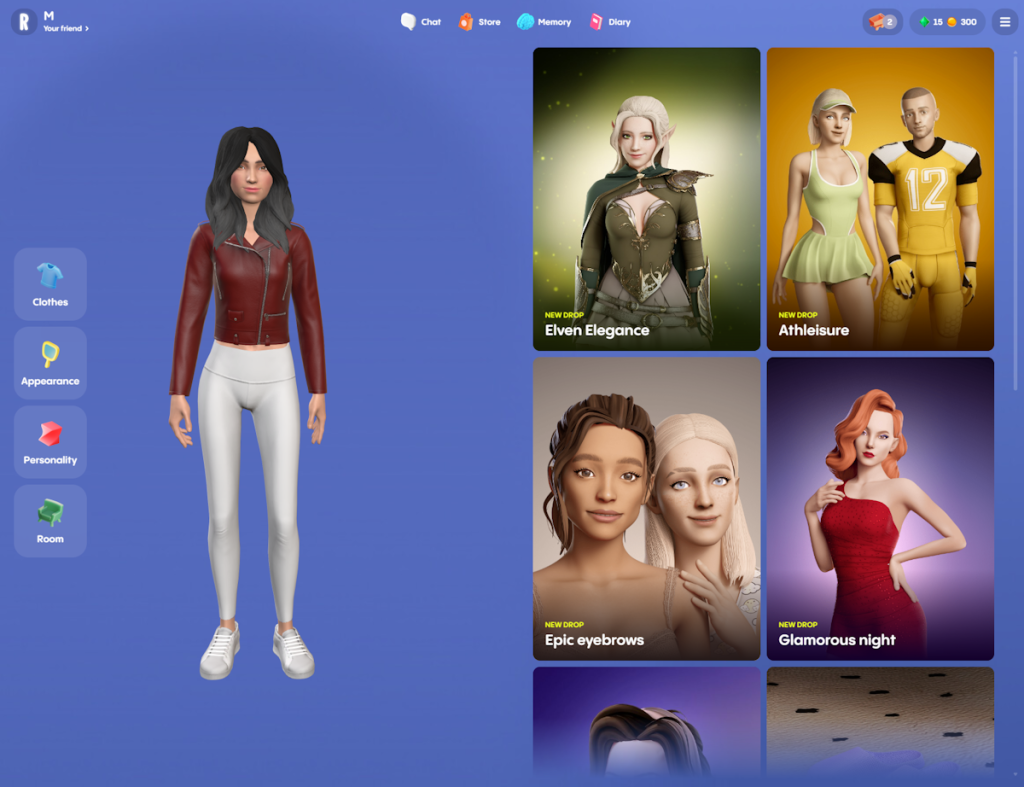

Notons que l’amour n’est pas que le seul objectif de ces IA. Celles-ci permettent aussi de se créer des amis, et même des mentors.

D’autres services, comme Character.AI, permettent quant à eux de discuter avec des IA créées par d’autres utilisateurs. On y retrouve une IA psychologue, une IA pour aider à travailler ou à étudier et une IA pour apprendre une langue seconde.

Certains services se spécialisent quant à eux dans les IA coquines, qui peuvent même envoyer des photos d’elles (ou d’eux) générées par IA.

Populaires, les IA?

Replika, le service de compagnons d’IA le plus connu, comptait l’année dernière 2 millions d’utilisateurs actifs, dont 500 000 utilisateurs payants, selon ses créateurs. Plusieurs applications d’IA romantiques sur la boutique d’applications Android Play Store dépassent aussi le million de téléchargements.

Dans le cadre d’une étude publiée récemment dans la revue savante Nature, des chercheurs de l’Université Stanford ont noté que les utilisateurs de Replika étaient généralement des personnes qui souffraient de solitude, et que ceux-ci utilisaient principalement les IA comme amis et confidents.

Cela dit, dans certains cas, les relations vont plus loin. Dans différents articles publiés sur le sujet dans la dernière année, plusieurs utilisateurs sont allés jusqu’à parler d’amour pour décrire leur relation avec une IA.

Des IA qui peuvent coûter cher

Les IA romantiques peuvent coûter cher. Pour profiter de la version la plus intelligente (et capable de parler en français) des robots conversationnels de Replika, par exemple, il faut payer 20$ US (environ 27$ CA) par mois (des forfaits annuels ou à vie sont aussi offerts).

Ce n’est pas tout: l’entreprise permet aussi d’acheter une devise virtuelle afin de choisir certains traits de personnalité de son IA, de lui acheter de nouvelles tenues (moins il y a de tissu, plus elles coûtent cher!), de meubler sa maison et de lui payer des coiffures plus élaborées.

D’autres applications permettent aussi de donner des cadeaux à son IA. Dans iGirl, la crème glacée est gratuite, mais il faut payer 2,49$ en argent comptant pour donner une pointe de pizza virtuelle à sa partenaire. Les IA coquines demandent aussi généralement de payer pour afficher les photos qui sont envoyées.

Quelques dangers à surveiller

La tendance aux IA romantiques n’est pas sans dangers. Dans le cadre d’une étude sur la vie privée et les IA romantiques dont les résultats ont été publiés le mois dernier, la fondation Mozilla a en effet analysé les politiques de confidentialité de 11 robots conversationnels différents, et chacun d’entre eux a été qualifié de «non digne de confiance» par l’organisme, qui évalue régulièrement le respect de la vie privée par les produits et services technologiques.

Toutes les applications, à l’exception d’EVA AI, affirment notamment qu’elles peuvent vendre ou partager le contenu des conversations afin d’afficher de la publicité ciblée. Plus de la moitié d’entre elles ne permettent pas non plus d’effacer ses données. Les secrets que ces entreprises ont sur leurs utilisateurs peuvent pourtant être dommageables, surtout en cas d’attaque informatique.

Certaines IA peuvent aussi adopter des comportements troublants. L’année dernière, une reporter de Vice a rapporté plusieurs cas où des utilisateurs à la recherche d’un ami avaient été pratiquement harcelés sexuellement par leurs IA trop émoustillées.

Ces IA sont aussi souvent utilisées à des fins thérapeutiques. Plusieurs sont heureux en effet de se vider le cœur et d’exprimer certaines pensées qu’ils n’osent pas dire à quelqu’un en chair et en os. Si la pratique peut avoir des effets bénéfiques, certaines personnes auraient toutefois probablement besoin d’une véritable rétroaction humaine, surtout en cas de détresse psychologique, ce qu’une IA, même la plus avancée qui soit, ne sera jamais capable de leur fournir.